最大45%のメモリ削減、妥協なし:Kubernetes上でのスマートなJavaワークロード最適化

なぜKubernetes上のJavaワークロードは最適化が難しいのか

Kubernetes上のJavaアプリケーションは、汎用的なリソースチューニングツールでは解決できない独特の最適化課題を抱えています。

メモリの盲点

VPAを含む多くのKubernetes最適化ツールや商用プラットフォームは、RSSやWorking Setといったコンテナレベルのメトリクスしか見ていません。しかし、Javaワークロードの真実はJVMの内部にあります:

- コンテナメトリクスは嘘をつく。 コンテナが4GBのメモリ使用量を報告していても、JVMヒープが2GB過剰にプロビジョニングされているのか、それともFull GCが発生寸前なのかは分かりません。

- ヒープが大きすぎる: メモリが遊休状態で、何の利益もなくクラウドコストを膨張させます。

- ヒープが小さすぎる: GC圧力が上昇し、レイテンシが急増し、OOMは時間の問題になります。

- 手動チューニングはスケールしない。

-Xmxを適切に設定するには深いJVMの専門知識が必要で、最適な値はトラフィックパターンの変化に応じて変わります。暗黙知はチームの人員交代に耐えられません。

根本原因:コンテナレベルの適正化とJVMヒープチューニングは、本来1つの協調最適化ループであるべきなのに、2つの別々の問題として扱われています。

起動時のスパイクジレンマ

Javaアプリケーションは、起動時(クラスのロード、JITコンパイル、Springコンテキストの初期化)に定常状態よりもはるかに多くのCPUを消費します。自動化がない場合、チームは不可能な選択に直面します。この点については、以下のResourceStartupBoostセクションで詳しく説明します。

実際の影響

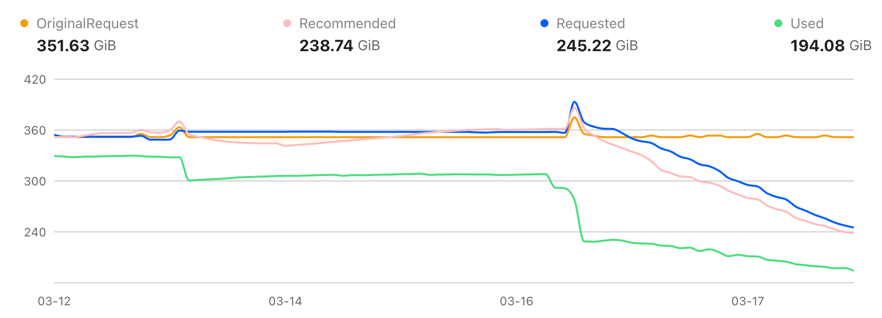

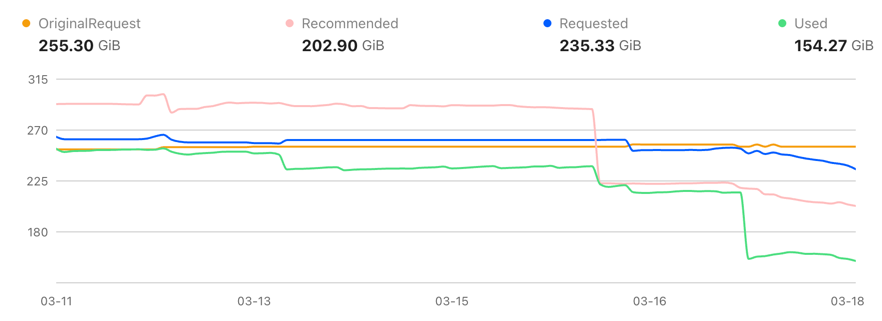

ある顧客は、複数のJavaベースのクラスタをCloudPilot AI Workload Autoscalerに導入しました。最適化パイプラインが効果を発揮した後、実際のメモリ消費量は全体的に劇的に減少しました。手動でのチューニングやサービスの中断は一切ありませんでした。

クラスタAでは、実際のメモリ使用量が約352 GiBから194 GiBに減少し、45%の削減を実現しました。一方、リクエストメモリは352 GiBから245 GiBへと適正化されました。

クラスタBでは、実際のメモリ使用量が約255 GiBから154 GiBに減少し、40%の削減を達成しました。リクエストメモリは255 GiBから235 GiBに減少しました。

両クラスタ全体で、この最適化により250 GiBを超えるメモリ消費量が削減され、合計で43%の削減を実現しました。

これは単に書類上のRequests/Limitsの変更ではありません。この削減は、JVMヒープとコンテナレベルの共同最適化によって実現された、実際のメモリ消費量の削減です。

私たちのソリューション

Javaメモリ最適化:「コンテナチューニング」から「JVM + コンテナの共同最適化」へ

主な機能

- JVMレベルの可観測性:

cloudpilot-node-agentは、ヒープの使用量/コミット量/最大量、GC頻度、GC停止時間、GC圧力トレンドをキャプチャします。これにより、外部のコンテナメトリクスだけに基づいて判断することはありません。 - 直接的なヒープ管理: ヒープ推奨範囲(

-Xmxを含む)は直接管理され、単一の最適化ループ内でPodメモリ推奨と調整されます。 - GCリスク制御: GC圧力、停止動作、割り当て率がすべての推奨に考慮されるため、コスト削減が信頼性を犠牲にすることはありません。

メモリ推奨の仕組み

目標は単に「メモリを縮小する」ことではなく、安定性と効率性の最適なバランスを見つけることです。

- 観察 --- JVMメトリクス(ヒープ、GC、割り当て傾向)とコンテナメトリクス(RSS、OOMKill履歴、再起動)を収集します。

- モデル化 --- デプロイ時のジッターなどの外れ値の重みを下げながら、複数ウィンドウのパーセンタイルを使用して真のヒープ需要を推定します。

- 推奨 --- バースト バッファとGC安全マージンを含む

-Xmx範囲と、非ヒープオーバーヘッド(メタスペース、コードキャッシュ、スレッドスタック、ネイティブメモリ)を考慮した対応するPod Requests/Limitsの組み合わせを生成します。 - 検証 --- ロールアウト後、GC、レイテンシ、OOM、使用率を継続的に監視します。リスク閾値を超えた場合は再調整します。

ResourceStartupBoost:Java起動時のリソーススパイクの解決

Javaアプリケーションは、起動時と定常状態で根本的に異なるリソースプロファイルを持っています。ResourceStartupBoostがない場合、チームは2つの不完全な戦略のいずれかを選択せざるを得ません。

2つの選択肢のジレンマ

選択肢A:定常状態に合わせてサイズ設定

定常状態の使用量に基づいてRequests/Limitsを設定すると、起動に支障が出ます。

- クラスローディング、JITコンパイル、Springコンテキストの初期化中のCPUスロットリングにより、起動が遅くなるか失敗します。

- Readinessプローブがタイムアウトし、繰り返しの再起動とスケジューリング圧力の連鎖が発生します。

- ローリングデプロイでは、新しいPodが十分な速さで起動できず、容量不足とユーザー向けエラーにつながります。

選択肢B:起動ピークに合わせてサイズ設定

起動時のスパイクをカバーできるようにRequests/Limitsを高く設定すると、定常状態が無駄になります。

- 数分間しか続かないバーストのために予約されたリソースが、何時間も何日もアイドル状態のままになります。

- スケジューラーは膨張したRequestsを確認し、Podの配置効率が低下し、クラスター全体のパッキング密度が減少します。

- 通常運用時のパフォーマンス向上はないまま、クラウドコストが増加します。

私たちのアプローチ:両方を実現

ResourceStartupBoostは、起動時の設定と定常状態の設定を分離することで、このトレードオフを解消します:

- 起動時(ブースト期間):Pod の CPU/メモリのリクエスト/制限を一時的に増加させ、起動時のピークオーバーヘッドを吸収します。これにより、スロットリングやタイムアウト障害のない、高速で信頼性の高い起動を保証します。

- 定常状態:安定化後、推奨される定常状態の値に自動的に戻ります。これによりリソースを回復し、クラスターのパッキング密度を高く保ちます。

結果:手動でのプロファイル管理なしに、オプションBの起動時の信頼性とオプションAのコスト効率を両立できます。

なぜノードオートスケーラーとの連携が必要なのか

ResourceStartupBoostは単独では機能しません。CloudPilotのノードオートスケーラーとの緊密な連携に依存しています。その理由は次のとおりです:

起動ブースト期間が完了すると、PodのCPUリクエストは定常状態のレベルに戻ります(例:4コアから1コアへ)。スタンドアロンのノードオートスケーラーは、これらの低い定常状態のリクエストのみを認識します。ノードには十分な空き容量があると判断し、より多くのPodをパッキングするか、「使用率の低い」ノードをスケールダウンします。

問題が表面化するのは、Podが再起動するときです。ローリングアップデート、クラッシュリカバリ、または再スケジューリングの際に、Podは再び起動ブーストを必要とします(例:4コア)。しかし、ノードは定常状態の数値に基づいてパッキングされているため、余裕がありません。結果:Podは保留状態になり、クラスターは新しいノードのプロビジョニングに奔走し、数秒で完了するはずの再起動が数分かかることになります。

CloudPilotは、ノードオートスケーラーをブースト対応にすることでこれを解決します。すべてのワークロードの起動ブーストプロファイルを把握し、その潜在的な需要をビンパッキングとスケーリングの意思決定に組み込みます。ノードオートスケーラーは、どのPodが再起動しても起動ブーストが即座に適合するよう十分なヘッドルームを確保します。緊急のノードプロビジョニングも、「念のため」のクラスター全体のオーバープロビジョニングも不要です。

内部の仕組み

CloudPilot AI Workload Autoscalerは、すべてのJavaワークロードに対して専用の最適化パイプラインを実行します:

- 識別:

cloudpilot-node-agentが各Podの言語とランタイムプロファイルを検出し、RuntimeLanguageによってワークロードを自動的に分類します。 - 観察: JVMの主要メトリクス(Heap使用量/確保量/最大値、GC頻度、GC停止時間、GC圧力トレンド、コンテナRSS/ワーキングセット、さらにPod OOMと再起動履歴)を収集します。

- 意思決定: 安定性目標(OOM回避、Full GCリスク削減)とコスト目標(アイドルメモリの無駄削減)の両方をモデル化し、Podリソース推奨値とJVM Heap推奨値を出力します。

- 実行: KubernetesのRequests/LimitsをJVM設定(

-Xmxなど)と連携させ、フィードバックに基づいて継続的にチューニングします。 - 起動ブースト: 起動期間中、

ResourceStartupBoostを有効にして一時的にリソースを増やし、アプリケーションが安定したら定常状態の推奨値にスケールバックします。

他社との比較

主要なJava固有の最適化機能について、最も一般的な代替製品を評価しました。すべてのプラットフォームが基本的なコンテナRequests/Limitsチューニングに対応していますが、JVMレベルのインテリジェンスと起動フェーズの認識において違いが現れます。

| 機能 | オープンソースVPA | Cast AI | ScaleOps | CloudPilot AI |

|---|---|---|---|---|

| コンテナRequests/Limitsチューニング | あり | あり | あり | あり |

| JVM Heap/GC可観測性 | なし | なし | あり | あり |

直接的な-Xmx管理 | なし | なし | あり | あり |

| Heap + GCリスク連動型の意思決定 | なし | なし | なし | あり |

| 起動と定常状態の分離 | なし | なし | なし | あり |

- オープンソースVPAは完全にコンテナ層で動作します。JVMへの可視性がないため、Javaヒープのプロビジョニングが過剰または不足する傾向があります。

- Cast AIは、インプレースPodリサイジングによる強力なコンテナレベルの最適化を提供しますが、JVMレベルの可視性やヒープパラメータ管理は提供していません。起動時のスパイクについては、統合されたブースト・フォールバックワークフローではなく、Kubernetesネイティブのメカニズム(起動プローブ、CPU制限の削除など)に依存しています。

- ScaleOpsは2025年後半にJVM対応リソース管理を導入し、ヒープ/GCの可視性と

-Xmxチューニングを提供しています。しかし、その最適化判断は、GCリスクシグナル(一時停止時間、圧力傾向、割り当て率)を推奨モデルに直接組み込むのではなく、ヒープをコンテナメモリに整合させることに重点を置いています。また、起動時と定常状態のリソース分離も提供していません。 - CloudPilot AIは、JVMレベルの可視性、GCリスクを考慮した意思決定による直接的な

-Xmxガバナンス、そしてフェーズ対応リソース管理のためのResourceStartupBoostを組み合わせ、完全なクローズドループ最適化パイプラインを実現しています。

まとめ

Javaワークロードに必要なのは、単にコンテナを小さくすることではなく、JVMとコンテナの協調的な最適化です。CloudPilot AI Workload Autoscalerは、3つの相互補完的な機能を通じてこれを実現します。

本番環境では、これは顧客クラスタ全体で実際に40〜45%のメモリ削減につながります。この削減は、RequestsやLimitsの単なる調整ではなく、実際の消費量から得られる節約です。

CloudPilot AIがあなたのJavaワークロードに何ができるかご覧になりたいですか? 詳細については弊社チームにお問い合わせください。